白话智能锁 AI基础软件开发中的安全挑战与应对之道

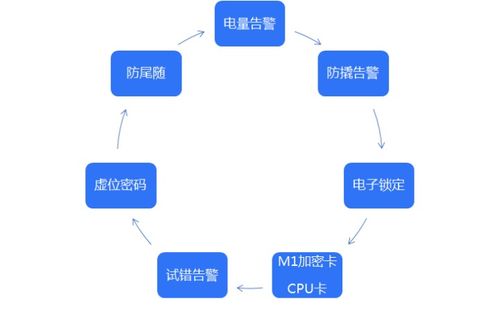

在物联网与人工智能技术深度融合的今天,智能锁作为家庭安全的第一道防线,正从简单的密码或指纹识别,迈向更为智能、便捷的体验。随着人工智能基础软件在智能锁产品中的广泛应用,其安全性问题也日益凸显。本文将从产品安全的角度,探讨智能锁中人工智能基础软件开发所面临的挑战与应对策略。

一、智能锁中的AI基础软件:机遇与风险并存

人工智能基础软件,通常指支撑AI模型训练、推理和应用开发的核心软件框架、算法库及工具链。在智能锁中,这类软件的应用主要体现在几个方面:

- 生物特征识别:如基于深度学习的指纹、人脸、声纹识别算法,提升识别的准确性和防伪能力。

- 异常行为分析:通过分析开锁习惯、门前活动等数据,利用机器学习模型判断潜在风险(如暴力开锁尝试、长时间逗留),并触发警报。

- 自适应学习与优化:系统能够根据用户使用习惯和环境变化(如光线、湿度对识别的影响)进行自我调优,提升用户体验。

这些应用带来了便利,但也引入了新的安全风险。攻击面从传统的物理锁芯、密码泄露,扩展到了软件漏洞、数据篡改、模型欺骗等更复杂的维度。

二、核心安全挑战:从代码到模型的层层防线

AI基础软件的开发与集成,给智能锁安全带来了独特挑战:

- 软件供应链安全:智能锁厂商往往集成或基于第三方AI框架(如TensorFlow Lite、PyTorch Mobile)和算法库进行开发。这些开源或商业组件若存在未公开漏洞,将成为整个系统的薄弱环节。供应链攻击(如投毒攻击)可能将恶意代码植入模型或库中。

- AI模型自身的安全:

- 对抗性攻击:攻击者可能通过精心构造的输入(如特制贴纸干扰人脸识别,或伪造指纹膜)欺骗AI模型,导致其做出错误判断(如将陌生人识别为户主)。

- 模型窃取与逆向工程:攻击者可能通过多次查询接口,反推出核心识别模型的参数或结构,进而设计更有效的攻击方法。

- 数据投毒:在模型训练阶段,如果用于训练的数据被恶意污染(如注入特定错误样本),可能导致模型在关键时刻出现系统性误判。

- 数据隐私与保护:智能锁采集的生物特征、行为数据极为敏感。AI软件的开发、部署和更新过程,必须确保这些数据在传输、存储和处理中得到充分加密和隔离,防止数据泄露。

- 系统集成与固件安全:AI软件模块需与锁具的嵌入式操作系统、通信模块(如蓝牙、Wi-Fi、Zigbee)紧密集成。任何接口的不安全调用、内存溢出或权限管理不当,都可能被利用来劫持控制权。

三、构建安全防线:开发实践与防护策略

为应对上述挑战,在智能锁的AI基础软件开发全周期中,需贯彻以下安全理念:

- 安全左移,贯穿全生命周期:从需求设计、代码编写、第三方组件选用、模型训练,到测试、部署与运维,每个环节都需嵌入安全考量。建立针对AI系统的安全开发流程。

- 强化供应链管理:

- 严格审核和评估所选用的AI框架、库的合规性与安全性记录。

- 优先选择有持续安全维护的版本,并及时更新补丁。

- 考虑对核心组件进行自研或深度定制,以减少对外部不可控因素的依赖。

- 加固AI模型:

- 对抗训练:在模型训练时引入对抗性样本,提升模型对恶意干扰的鲁棒性。

- 模型混淆与加密:对部署在端侧(锁内)的模型进行加密、混淆或使用专用安全芯片进行保护,增加逆向工程难度。

- 持续监控与更新:建立模型性能与异常行为的监控机制,一旦发现识别成功率异常波动或遭受攻击迹象,能及时触发安全响应和模型迭代。

- 夯实系统基础安全:

- 最小权限原则:严格控制AI软件模块的访问权限,确保其只能访问完成功能所必需的数据和资源。

- 安全的通信与存储:使用强加密协议(如TLS)进行数据传输,对敏感数据(如特征模板)进行本地加密存储,且密钥由安全芯片保管。

- 安全的固件更新机制:确保AI模型和软件更新的完整性与真实性,必须通过数字签名验证,防止恶意固件植入。

- 独立的渗透测试与审计:定期邀请专业安全团队对智能锁产品,特别是其AI功能模块,进行“白盒”与“黑盒”渗透测试,模拟真实攻击场景,发现并修复深层漏洞。

四、安全是智能锁AI化的基石

人工智能为智能锁赋予了前所未有的“智慧”,但这份智慧必须建立在坚固的安全基石之上。对于智能锁厂商和AI基础软件开发者而言,安全不再是附加功能,而是产品设计与开发的核心驱动力。唯有将安全思维深度融入从算法研究到软件实现的每一个环节,构建多层次、纵深防御的安全体系,才能真正让智能锁成为用户值得信赖的“电子卫士”,在提供便捷的牢牢守住家庭与财产的安全之门。

技术的进步永无止境,攻击者的手段也在不断演化。因此,智能锁的安全建设是一场持续的攻防博弈,需要开发者、安全研究人员和行业监管者的共同努力,以筑牢这扇通往智能生活的“安全门”。

如若转载,请注明出处:http://www.hongxinxinxikeji.com/product/81.html

更新时间:2026-04-22 02:16:17